파인튜닝 모델 평가부터 배포까지 — 실전 완결편

Perplexity, KoBEST, ROUGE-L로 모델 평가. merge_and_unload()로 어댑터 머지, GGUF 변환, vLLM/Ollama 배포. 과적합 방지, 데이터 품질, 하이퍼파라미터 가이드.

파인튜닝 모델 평가부터 배포까지 — 실전 완결편

Part 1에서 LoRA의 원리와 첫 파인튜닝을, Part 2에서 QLoRA와 한국어 데이터셋 구축을 다뤘습니다. 학습은 끝났습니다. 이제 남은 질문은 두 가지입니다:

시리즈: Part 1: LoRA 이론 | Part 2: QLoRA + 한국어 | Part 3 (이 글)

- 이 모델, 진짜 좋아진 건가? (평가)

- 어떻게 사용자에게 제공하지? (배포)

관련 포스트

Models & Algorithms

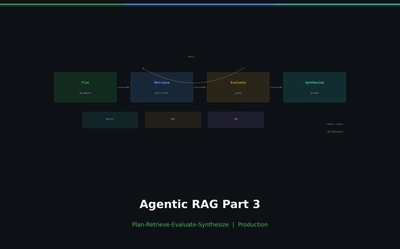

Agentic RAG 파이프라인 — 멀티스텝 검색의 프로덕션 적용

Plan-Retrieve-Evaluate-Synthesize 풀 파이프라인 구현. Vector + Web + SQL을 Tool로 통합하고, 환각 탐지와 소스 그라운딩으로 신뢰도를 확보합니다.

Models & Algorithms

Self-RAG과 Corrective RAG — Agent가 자기 검색을 평가하는 법

Self-RAG의 reflection token 메커니즘과 CRAG의 품질 기반 폴백 전략을 구현합니다. LangGraph conditional edge로 retry/fallback 로직 구성.

Models & Algorithms

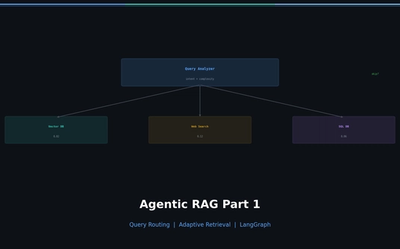

Agentic RAG 첫걸음 — Query Routing과 Adaptive Retrieval

Naive RAG의 한계를 진단하고, 쿼리 의도를 분류해 최적의 검색 소스로 라우팅하는 Agent를 LangGraph로 구현합니다. Adaptive Retrieval로 불필요한 검색을 제거하는 방법까지.